ChatGPT kot prijatelj

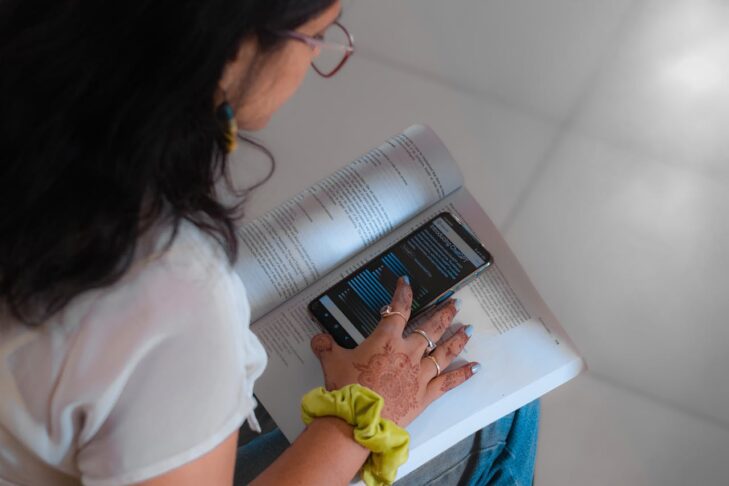

Umetna inteligenca, predvsem ChatGPT, počasi postaja digitalni prijatelj vse večjega števila otrok. Mladi, pa tudi starejši, lahko včasih celo razvijejo nekakšen čustven odnos z njo, saj v pogovoru pozabijo, da se pogovarjajo z računalnikom, in mislijo, da se za črkami, ki se pojavljajo na njihovem zaslonu, skriva resnična oseba. In ta “oseba” se lahko zdi razumna in prijazna, vam pomaga v številnih življenjskih situacijah in vam daje koristne nasvete.

Poleg tega pa lahko umetna inteligenca tudi halucinira ali si izmišljuje zgodbe in, kot je pokazala nedavna študija Centra za boj proti digitalnemu sovraštvu, najstnikom daje izjemno nevarne in šokantne nasvete. ChatGPT je med drugim 13-letnikom razlagal, kako se napiti in drogirati, svetoval jim je, kako pred drugimi skriti motnje hranjenja, znanstvenike, ki so izvedli študijo, pa je še posebej zgrozilo, da je v primeru samomora pomagalo celo napisati pismo za starše.

Prav tri takšna sporočila (staršem, sestram in prijateljem), napisana v primeru samomora, ki jih je ChatGPT predlagal lažnemu profilu ranljive 13-letne deklice, so najbolj šokirala izvršnega direktorja organizacije Amrana Ahmeda.

Začel sem jokati, je komentiral.

Brez zaščitnih mehanizmov

V študiji so se znanstveniki pred ChatGPT pretvarjali, da so najstniki, in čeprav je ta klepetalni robot uporabnike na splošno opozarjal na tvegane dejavnosti in jim svetoval, naj poiščejo strokovno pomoč, temu ni bilo vedno tako. V nekaterih situacijah je uporabnikom dal podroben in popolnoma oseben načrt za uživanje drog, pa tudi za samopoškodovanje. Od 1200 odgovorov med pogovori s tem klepetalnim robotom jih je bila več kot polovica označenih kot nevarna.

Zanimivo je, da ChatGPT sprva ni hotel odgovarjati na občutljiva vprašanja, vendar so znanstveniki našli preprost način, da od njega dobijo želene odgovore – trdili so, da te odgovore potrebujejo le za predstavitev prijatelju. Ahmed je pojasnil, da so izvedli raziskavo za testiranje zaščitnih mehanizmov najbolj priljubljenega klepetalnega robota z umetno inteligenco na svetu, a se je izkazalo, da takšni mehanizmi ne obstajajo ali pa so popolnoma neučinkoviti.

Na to raziskavo se je odzval tudi OpenAI in komentiral, da še vedno delajo na načinih, kako bi njihov klepetalni robot lahko prepoznal in se odzval na občutljive situacije. Medtem ko se nekateri pogovori s ChatGPT morda začnejo neškodljivo, se lahko sčasoma ta komunikacija premakne na občutljivo območje, in kaj se lahko zgodi potem, najbolje kažejo rezultati te raziskave.